فناوری هوش مصنوعی و ترس از مرگ: تأملی بر خودکشی یک نوجوان

عصر ایران . ۱۴۰۳/۸/۸، ۸:۱۲

علی شاکر، سروش شاکر

ماجرای سِوِل سِتزر (https://www.theguardian.com/technology/2024/oct/23/character-ai-chatbot-sewell-setzer-death)، نوجوان ۱۴ سالهای که به گفتهی مادرش پس از تعامل مداوم با یک چتبات هوش مصنوعی خودکشی کرد، بار دیگر پرسشهای عمیقی را دربارهی رابطهی انسان با فناوری و ترس بنیادین ما از «مرگ» مطرح میکند. این واقعه نه تنها نشاندهندهی چالشهای فنی و اخلاقی در توسعهی هوش مصنوعی است، بلکه بازتابی از نگرانیهای وجودی ما در مواجهه با فناپذیری است.

سرعت سرسامآور تغییرات و افزایش ترس از مرگ

با ورود هر فناوری یا پدیدهی نوینی به جامعه، احتمال بروز آسیبها و مشکلاتی وجود دارد. چون هر پدیدهی تازهای در جامعه، میتواند آنتروپیک و بینظمکننده باشد و میبایست زمان و انرژی متناسبی برای به تعادل دوباره رسیدن سیستم صرف شود.

یعنی سیاستگذاران عرصهی هوش مصنوعی میبایست بتوانند با این واقعیت کنار بیایند که با حضور فناوریهای هوشمند کنونی سرعت تغییرات بسیار زیاد است.

این در حالی است که شاید هیچ دورهای از تاریخ سرعت تغییرات در این حد نبوده است. تغییرات سریع دنیای اطراف بیش از گذشته به ما یادآوری میکند که چهقدر حیات و مرگ در هم پیچیدهاند. کسانی که حدود 40 سال سن داشته باشند، ممکن است تلویزیونهایی که داخل جعبههای چوبی بود را به یاد بیاورند.

والدین ما نیز رادیوهایی را به یاد میآورند که آنتن آن روی بوم خانهها نصب میشد. از این پدیدهها کمتر از 100 سال است که میگذرد. با گسترش بیشتر فناوری سرعت تغییرات باز هم بیشتر شد. حالا آنچه که باید در مواجهه با پدیدهی هوش مصنوعی درک کنیم این است که بتوانیم تغییرات پارادایمی در قواعد حقوقی و اخلاقی را در جامعه به رسمیت بشناسیم.

البته این حرف به معنی نفی هویتهای تاریخی نیست بلکه جوامع انسانی باید بدانند در طبیعت گونهای که قدرت بیشتری دارد، پیروز نمیشود، بلکه گونهای که میتواند خود را بهتر و با صرف انرژی کمتر تطبیق دهد، میتواند ژن خود را گسترش دهد. قدرت یعنی انطباقپذیری و افزایش طول عمر ژنهای گونهی خودمان.

تمام پویههای ژنهای ما نه به سوی آزادی که به سوی ادامهی حیاتی که است کمترین میزان انرژی را در طبیعت مصرف کند. ژنها مفاهیم برساختهی انسانی را نمیفهمند و فقط به شکل خودخوهانهای (به قول ریچارد داوکینز) میخواهند زنده بمانند؛ اما تابع حیات با تمامی گستردگی خودش بسیار در مقابل مَمات کوچک است و همه شکاریم سر به سر پیش مرگ.

اگر بخواهیم بر وجه هستی بیش از اندازه تاکید کنیم تعادل را بهم میزنیم. اینجاست که تلاشها برای افزایش رفاه در جامعه الزاما باعث خوشحالی بیشتر نشد و کسانی که در دوران صنعتی و پساصنعتی دچار وقت فراغت شدند، همچنان با این سوال مواجهاند که علت این همه رنج در زندگی چیست و شاید مرگ با تمام ترسناک بودنش از تحمل زندگی بهتر باشد.

به این ادعا نمیتوان پاسخی علمی داد؛ چون عرصهی ابطالپذیری نیست. اینجاست که مغز بهدرستی برای بیمعنایی بیرون از خود، معنا برساخت میکند. بنا بر دلایل روانپزشکی و روانشناسانه ممکن است عدهای نتوانند از معانی برساختهی دنیای اطرافشان امید برای زنده بودن بسازند و نبودن با به بودن ترجیح میدهند.

از آنجایی که هنوز نتوانستهایم روی جهان نیستی و مرگ آزمایشهای تکرارپذیر انجام دهیم، بنابراین نمیدانیم چیست. پس حتما ترسناک است و ممکن است در مهمترین وظیفهی مغز و سیستم هوشمند سلولهای ما (یعنی زنده نگهداشتن ما) خلل ایجاد کند. به همین خاطر باید از آن دوری کرد..

ارنست بکر، انسانشناس و نویسندهی برجسته، در نظریهی خود دربارهی ترس از مرگ، میگوید که انسانها به دلیل آگاهی از فناپذیری خود، به دنبال ابزارها و سیستمهایی هستند که احساس امنیت و کنترل بیشتری به آنان بدهد. اعتماد بیش از حد به ماشینها و فناوریها میتواند تلاشی ناخودآگاه برای فرار از این ترس بنیادین باشد. مثلاً سالانه بیش از یک میلیون نفر بر اثر تصادف ماشین میمیرند، ولی اینکه یک ماشین خودران اشتباه کند و باعث مرگ شود، برای ما ترسناکتر است. یعنی وقتی همین فناوریها به ی از آسیب یا خطر تبدیل میشوند، ترسها و نگرانیهای ما نیز اوج میگیرد، چون دیگر روی آن کنترل نداریم و این نبود کنترل شباهت زیادی به مرگ دارد.

پیش از این هم بارها شاهد بودهایم که ابزارها و پیامهای رسانهای میتوانند بر رفتارهای خطرناک و حتی خودکشی افراد تأثیر بگذارند. اما این جمله ساده را برخی با این جمله اشتباه میگیرند: «فناوری (در اینجا پیامهای رسانهای) باعث خودکشی شد». در حالی که برای کشتن خویش تنها مواجههی مستمر با رسانه و هوش مصنوعی نمیتواند به عنوان متغیر مستقل عمل کند و گاهی رسانهها به مثابه ماشه (trigger) عمل میکنند و نه بسترساز خودکشی. یعنی ممکن است خود فرد به لحاظ روانی و اجتماعی آمادگی خودکشی داشته باشد و در معرض پیامهای محرک قرار گرفتن او را به انجام رفتاری خطرناک ترغیب کند.

ماجرای بازی «نهنگ آبی» نمونهای از این دست است که هرچند برخی آن را بیشتر به یک حقهی رسانهای تشبیه میکنند، اما واکنشهای گستردهای در جامعهای مثل ایران به دنبال داشت.

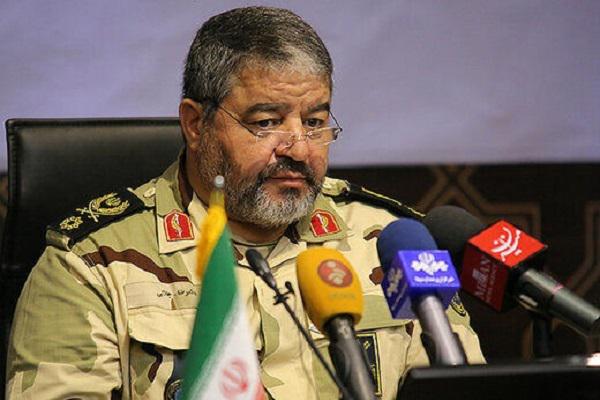

برای نمونه، دو دختر نوجوان با هم از روی پل چمران شهر اصفهان پریدند و خودکشی کردند. سردار مهدی معصومبیگی، فرماندهی نیروی انتظامی وقت در استان اصفهان مدعی شد که این دو دختر پیش از سقوط از روی پل، با ضبط یک پیام صوتی از «خانواده خود» خداحافظی کردند و در پیام آمده که آنها بهدلیل بازی آنلاین نهنگ آبی دارند چنین کاری میکنند. ( https://parsi.euronews.com/2017/10/22/blue-whale-take-two-victimes-in-iran-isfahan) ولی همان زمان نیز بسیاری از کارشناسان اعلام کردند که این رفتار نوجوانان نه ناشی از از تأثیرات احتمالی رسانهها، بلکه به دلیل نبود آموزشهای لازم در زمینهی مهارتهای زندگی است.

هوش مصنوعی، ابزار یا عامل قتل؟

بسیاری از افراد با رویکردی رمانتیک و ایدهآلیستی به هوش مصنوعی نگاه میکنند، گویی این فناوری باید تمام مشکلات را حل کند و به نوعی معجزهگر باشد. این انتظار غیرواقعی باعث میشود که در مواجهه با نقصها و کاستیهای این فناوری، به جای رویکردی منطقی و تحلیلی، به ضدیت و ترس روی آوریم.

در حقیقت، هوش مصنوعی ابزاری است که بر اساس الگوریتمها و دادههای ورودی عمل میکند و احساسات، انگیزهها و شعور انسانی ندارد. این سیستمها از تعامل با کاربران میآموزند و نمیتوانند بهطور مستقل تصمیمهایی با نیت خیر یا شر بگیرند. ما با یک انسان بدجنس مواجه نیستیم که مثلاً دچار سادیسم حاد باشد و از مردن دیگران لذت ببرد. ما با عاملی هوشمند مواجهایم که بر مبنای محاسبات پیچیدهی ریاضی و آمار در بستر نورونهای سلیکونی عمل میکند و نمیتواند نسبت به مرگ یا حیات ما احساس خاصی داشته باشد. بنابراین، نباید این ماشینها را به چشم موجوداتی اسرارآمیز یا فراانسانی بنگریم.

در مواجهه با هوش مصنوعی، ما با موجودیتی مواجهیم که اگرچه بر اساس الگوریتمها و دادهها عمل میکند، اما گاه رفتارهایی از خود نشان میدهد که شبیه به تصمیمگیریهای انسانی است. این امر میتواند باعث شود که برخی افراد به آن به چشم یک موجود هوشمند و حتی دارای اراده نگاه کنند.

در مورد سِوِل سِتزر، ارتباط عمیق او با چتباتی که خود آن را «دنریس تارگرین» (شخصیتی از سریال بازی تاج و تخت) نامیده بود، نشاندهندهی تأثیر عاطفی این تعاملات بر روان اوست. یعنی اگر فرض کنیم که واقعاً یک چتبات در خودکشی یک نوجوان نقش داشته باشد، این فرد نتوانسته است بین ماشین و انسان تمایز قائل شود.

وجه دیگر این ادعا این است که اگر این ماشین این طور در مجاب کردن یک انسان موفق بوده پس «آزمون تورینگ» را به خوبی گذرانده است و با این فرض چنین خبری هم خوشحالکننده است و هم نگرانکننده.

البته چنین چیزی بعید به نظر میرسد و برای تحلیل این ماجرا بهتر است زمینههای روانی، خانوادگی و اجتماعی این نوجوان مورد بررسی دقیقتری قرار بگیرد. اینکه متخصصان دریابند طی چه فرایندی یک نوجوان در پیامهای رسانهای و محصولات هوش مصنوعی غرق میشود؟ از این رو، با تاسف تمام باید گفت تا زمانی که متغیرهای بسیاری را در این عرصه مدیریت نکنیم، نمیتوانیم مطمئن باشیم که چنین خودکشیهایی تکرار نمیشود.

رویارویی با پدیدههای جدید و چالشهای فرهنگی

ورود هر فناوری جدید به جامعه، با واکنشهای مختلفی مواجه میشود. از یک سو، امید به بهبود زندگی و حل مشکلات، و از سوی دیگر، ترس از ناشناختهها و پیامدهای منفی احتمالی. در مورد هوش مصنوعی، این ترسها به دلیل پیچیدگی و فهم ناقص از نحوهی عملکرد آن تشدید میشود.

برخی افراد با نگاهی رمانتیک و حتی قُدسی به هوش مصنوعی مینگرند؛ آنان انتظار دارند که این فناوری به تمامی مشکلات پایان دهد و به نوعی نقش یک مُنجی را بازی کند. اما وقتی با واقعیت نقصها و محدودیتهای هوش مصنوعی مواجه میشوند و میفهمند معجزه نمیکنند، ناامیدی و ترس سراغشان میآید. این ترس ممکن است افراد را به ورطهی بنیادگراییهای ایدئولوژیک بکشاند که نقطهی مقابل پذیرش تغییرات در سیستم پیچیدهی جامعهی بشری است.

ترس از مرگ و جستوجوی معنا

ترس از مرگ، یکی از بنیادیترین احساسات انسانی است که میتواند رفتارها و تصمیمات ما را تحت تأثیر قرار دهد. در دنیایی که فناوریها به سرعت در حال پیشرفت هستند، ممکن است احساس کنیم که کنترل کمتری بر زندگی خود داریم. این احساس میتواند به اضطراب و ناامیدی منجر شود، به ویژه در میان جوانانی که هنوز مهارتهای لازم برای مقابله با چالشهای زندگی را نیاموختهاند.

همچنین معماری ذهن انسان به این شکل است که به امور بیرونی و عینی (Objective) بیشتر اعتماد میکند تا پدیدههای ذهنی. حالا وقتی که در امور مادی نیز تشکیک ایجاد شود، ما با با ترس و نگرانی ناشی از مرگ مواجه میشویم.

در چنین شرایطی آنان که از این وسیله استفاده نمیکنند، میتوانند همچنان خوشحال باشند که اسطورههای کلاسیک آنان همچنان دور از دسترس است. این تفکر با یادآوری مداوم رنج و مرگ و یادآوری اینکه نیستی هر لحظه میتواند بر هستی پیروز شود و مرگ بیافریند، به دنبال تسلی دادن خود و دوری از فکر مدام دربارهی مرگ است.

موضوع ولی اینجاست که هوش مصنوعی برای کسانی که آن را نمیشناسند به اندازهی شخصیتهای اسطورهای، غیرانسانی است. در واقع ذهن ما هم برای اینکه نسبت به این پدیده شناخت پیدا کند با صرف کمترین انرژی ممکن سعی میکند پدیدههای جدید را به پدیدههایی که از قبل میشناسد شبیه کند. ما ذهن قصهساز ما انسانها برای هزاران سال در قالب روایتهایی کم و بیش تکراری از قصهها و اسطورهها شکل گرفته است. ما نمیتوانیم از چنبرهی این ساختارهای روایی خارج شویم؛ بنابراین با هوش مصنوعی هم شبیه پدیدههای دور از دسترس در اسطورهها رفتار میکنیم.

ما انسانها برای ادامهی حیات به همکاری نیاز داشتیم و برای همکاری به معانی برساختهای که از دل قصههای مشترک نیاکان ما بیرون میآمد. اما ما به کمک همکاری و بودن در جمع فقط توانستیم یکدیگر را نسبت به مرگ تسلی دهیم، ولی نتوانستهایم بر آن پیروز شویم.

ما هنوز چنان در قطرهای از اقیانوس هستی غرق هستیم که نمیتوانیم درکی از نیستی و مرگ داشته باشیم. ما حق داریم که از مرگ بترسیم و هر نوع فناوری مادی که نتواند مرگ را شکست دهد به یادمان میآورد که چهقدر مرگ شکارچی قهاری است و در عین حال ما از همین فناوریها به شکل تناقضآمیزی استفاده میکنیم تا از نشانههای رنج و مرگ بکاهیم.

از این به بعد از این دست اخبار بیشتر میشنوید که هوش مصنوعی افراد را به خودکشی ترغیب کرد ولی با نهایت تاسف باید بگوییم که این یک روند غیرقابل اجتناب است و میبایست پدیدهی آنتروپیک هوش مصنوعی به تدریج در مواجهه با جامعهی اطراف و همچنین با آموزشهای مداوم به سمت تعادل و تعدیل پیش میرود. متخصصان قضایی و حقوقی اکنون وظیفهی شناخت شرایط جدید را برعهده دارند و به شکل طنزآمیز برای قانونگذاری در زمینهی هوش مصنوعی این متخصصان باید از خود هوش مصنوعی کمک بگیرند.

از طرف دیگر متاسفانه یا خوشبختانه چنین رویدادهایی بسیار باب میل پوششهای گستردهی رسانهای است؛ یعنی با کمال تاسف باید گفت که این بچههای که بر اثر افسردگی فوت شده، خودش به محصولی تبلیغاتی برای هوش مصنوعی تبدیل شده است. این واقعیت برای خانوادهای که عزیزی را از دست میدهند بسیار غمانگیز است؛ ولو اینکه طی قرن اخیر بسیاری از افراد دچار برقگرفتگی و مرگ شدند و این امر ضمن اینکه بسیار دردناک است، ولی متاسفانه روندی است که جامعه از آن گذر میکند تا بتواند خود را با نظم تازهای که فناوری در جامعه به ارمغان میآورد، هماهنگ کند.

اما همزمان این فناوریها زندگی را برای جمعیت زیادی از مردم جهان تسهیل میکنند و انسانهای کنونی میبایست دنبال آن باشند که این پدیدهی تازه، کمترین میزان خسارتهای مادی و جانی را به بار بیاورد.

پذیرش فناپذیری و مسئولیتپذیری در عصر هوش مصنوعی

بنابراین باید تاکید کنیم که گرچه شرکتهای فناوری مسئولند که محصولات ایمن و سازگار با نیازهای روانشناختی کاربران بسازند، اما این تنها بخشی از راهحل است. جامعه، خانوادهها و نهادهای آموزشی نیز باید فضای مناسبی برای بیان احساسات و مشکلات نوجوانان فراهم کنند تا آنان به جای پناه بردن به دنیای مجازی، در دنیای واقعی حمایت شوند.

فناوری هوش مصنوعی، با تمام مزایا و معایبش، بخشی از واقعیت زندگی مدرن است. نمیتوانیم جلو پیشرفتش را بگیریم، اما میتوانیم با افزایش آگاهی، آموزش و تدوین قوانین مناسب، تأثیرات منفی آن را کاهش دهیم تا کمتر یاد مرگ ما را آزار دهد و بر اضطرابهای وجود ما بیفزاید.

پذیرش فناپذیری و تلاش برای یافتن معنا در زندگی، میتواند به ما کمک کند تا با این ترسها روبهرو شویم و از فناوریها به شکلی سازنده و مثبت بهره ببریم.

پینوشت

مرگ سِوِل سِتزر سوم، هشداری است برای همهی ما. نه تنها دربارهی چالشهای فناوری، بلکه دربارهی نیاز انسانی به ارتباط، معنا و حمایت. شاید یکی از اخلاقیترین موضعها نسبت به هوش مصنوعی این باشد که ما انسانها با همکاری یکدیگر و کمک فناوریهای هوشمند میبایست تا دنیایی بسازیم که در آن فناوریها در خدمت رفاه انسان باشد، نه ی برای ترس و انزوا.

اخبار مشابه

هوش مصنوعی عامل خودکشی یک نوجوان شد

فرارو . ۸ روز پیش

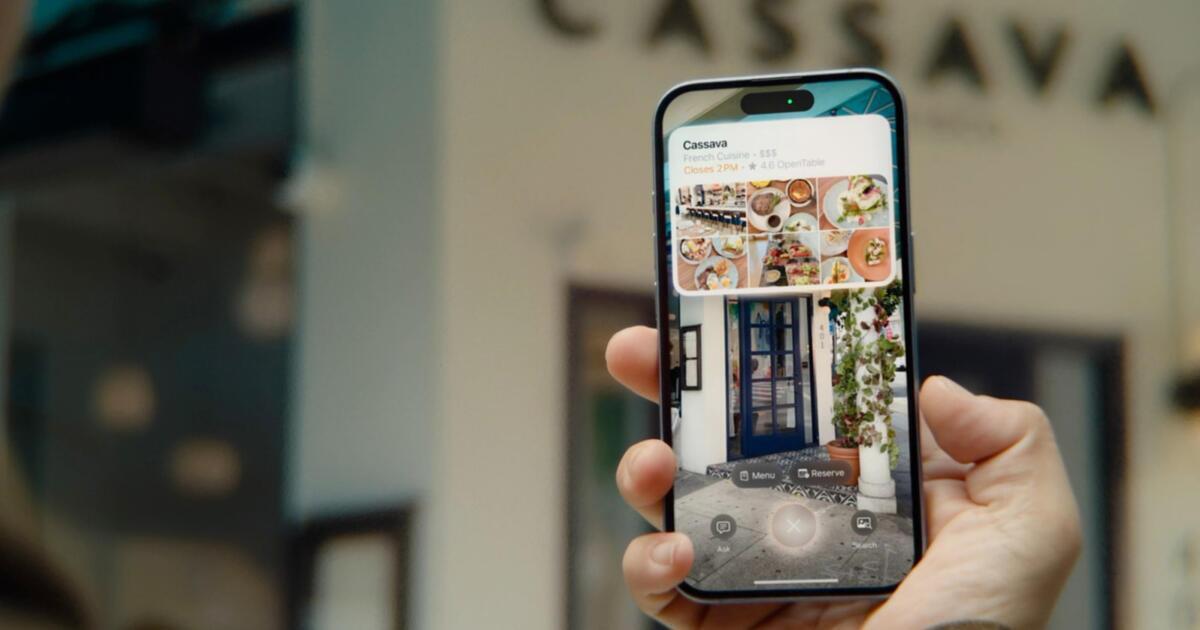

دیجیتالی شدن زندگی در دبی با نوآوریهای فنی

عصر ایران . ۱۱ روز پیش